5年前將《GPU Gems 2》中的“Octree Textures on the GPU”用到了論文的實(shí)時(shí)紋理創(chuàng)作一節(jié)�,那時(shí)候CUDA才剛出生���,OpenCL應(yīng)該還在規(guī)范階段,所以將GPU用于加速和通用計(jì)算的成熟方法還是compution by texturing。至于同樣的計(jì)算量在CPU和GPU上跑,性能到底提升多少�����,也沒(méi)有做過(guò)對(duì)比實(shí)驗(yàn)。周末翻了下《CUDA by Example: An Introduction to General-Purpose GPU Programming》,基本掌握了用CUDA編寫(xiě)GPU思想和語(yǔ)法�,比起將數(shù)據(jù)做為紋理�、Shader寫(xiě)算法來(lái)���,進(jìn)步了不少:1)開(kāi)發(fā)人員不需要熟悉渲染管線及圖形API���;2)不用花時(shí)間去搭建DX或者OpenGL的框架���;3)Host與Device代碼混編�;4)不必采用Hacking思想處理包裝成紋理的數(shù)據(jù);5)可指定參與計(jì)算的線程數(shù)�。有了如此方便的編程環(huán)境�,就隨手來(lái)做一下對(duì)比吧�,這個(gè)例子來(lái)自《CUDA by Example》的4.2.2生成Julia集。

測(cè)試代碼需要做一些調(diào)整���,才能更好地體現(xiàn)出GPU的平行計(jì)算優(yōu)勢(shì),這其中牽涉到支持CUDA的GPU架構(gòu)知識(shí),在這里做一下梳理���。

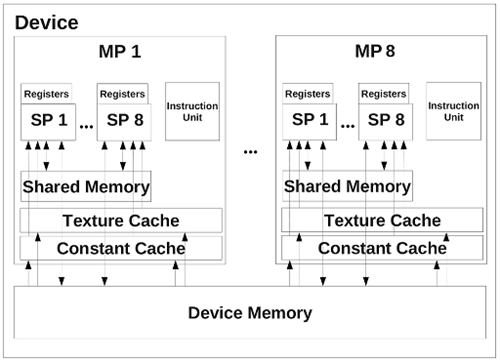

在Nvidia推出Fermi架構(gòu)之前,支持CUDA的Nvidia顯示芯片都是由多個(gè)Streaming Multiprocessor(簡(jiǎn)稱(chēng)SM)組成,每個(gè)SM包含了八個(gè)Stream Processor(簡(jiǎn)稱(chēng)SP),每四個(gè)SP組成一個(gè)組�����,也就是說(shuō)SM實(shí)際上可以看成包含兩組4D的SIMD處理器���。此外���,每個(gè)SM還包含Register�����、share memory、texture cache以及constant cache���。在執(zhí)行 CUDA 程序的時(shí)候,每個(gè)SM對(duì)應(yīng)一個(gè) block,而每個(gè)SP就是對(duì)應(yīng)一個(gè) thread�����。雖然一個(gè)SM只有八個(gè)SP�,但是由于SP進(jìn)行各種運(yùn)算都有延遲,更不用提內(nèi)存存取的延遲了�����,因此 CUDA 在執(zhí)行程序的時(shí)候,實(shí)際是以 warp 為單位。目前的支持CUDA顯卡�,一個(gè) warp 里面有32個(gè) threads���,分成兩組16 threads的half-warp�。由于SP的運(yùn)算至少有4個(gè)時(shí)鐘周期的延遲�,因此對(duì)一個(gè)4D的SP來(lái)說(shuō),一次至少執(zhí)行16個(gè) threads(即 half-warp)才能有效覆蓋掉各種運(yùn)算的延遲[1]。

圖 1

在GeForce GTX 400系列上�����,Nvidia采用了全新的Fermi架構(gòu)[2]�,之后的顯卡的Compute Capability也從1.3躍升至2.0。SP改名為CUDA Core,提升到了32個(gè)/SM[3]�。圖2為Fermi核心演變�,從GF104和由其發(fā)展起來(lái)的GF114�����、GF106、GF108的CUDA Core都上升到了48個(gè)/SM�����,支持2.1的Compute Capability���,而GF100和GF110依舊是32個(gè)���。最新基于Kepler架構(gòu)的GeForce GTX 680支持3.0的Compute Capability���,CUDA Core數(shù)量達(dá)到了192個(gè)/SM�����。

_thumb.png)

圖 2

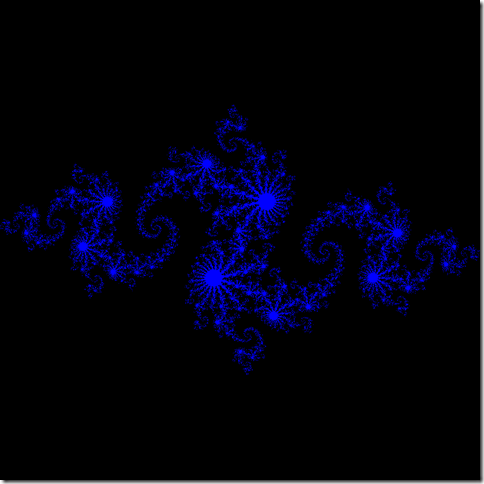

由于測(cè)試平臺(tái)采用的是GTX 560 Ti�,所以需要分析一下它的架構(gòu)�����。GTX 560 Ti由8個(gè)SM組成�,下圖中�,左邊是從程序獲取的設(shè)備屬性,右邊為單個(gè)SM內(nèi)部結(jié)構(gòu)示例圖�����?����?梢钥吹?,GTX 560 Ti的每個(gè)SM配備了兩個(gè)Warp調(diào)度器�����,因此每個(gè)周期對(duì)兩個(gè)包含32個(gè)線程的Warp進(jìn)行分發(fā)。另外���,對(duì)于一個(gè)二維圖像,為kernel指定2D的grid和block可使代碼更加直觀�����。為此�����,block采用(16,16)���,總共分配256個(gè)(64*4)threads在一個(gè)SM上執(zhí)行���,如果需要產(chǎn)生1024*1024的Julia分形圖�,則需要grid為(64,64)。

_thumb.png)

_thumb.png)

圖 3

測(cè)試平臺(tái)為:

_thumb.png)

測(cè)試代碼說(shuō)明:

1)代碼分為CPU實(shí)現(xiàn)和CUDA實(shí)現(xiàn)�����;

2)均采用CPU計(jì)時(shí)方法�����;

3)只針對(duì)計(jì)算部分測(cè)試���,不包括內(nèi)存分配�、傳輸以及文件寫(xiě)入�;

下面列出main函數(shù)代碼���,左邊為CPU實(shí)現(xiàn)���,右邊為CUDA實(shí)現(xiàn)�,均編譯為release版本。

_thumb.png)

_thumb.png)

測(cè)試結(jié)論:CPU版本耗時(shí)244ms�����,CUDA版本耗時(shí)2.1087ms���。這可是100倍的效率提升啊�。不過(guò)CPU版本沒(méi)有經(jīng)過(guò)多核優(yōu)化,所以這樣這樣對(duì)比實(shí)在不公平,但這卻凸顯出CUDA C將并行思想融入語(yǔ)言規(guī)則的優(yōu)勢(shì)�����。

在驚訝GPU用作通用計(jì)算的執(zhí)行效率時(shí)���,別忘了它還是有諸多應(yīng)用上的問(wèn)題:

1)初始化耗時(shí)���,需要在顯存分配空間�,然后將數(shù)據(jù)從內(nèi)存copy到顯存;

2)數(shù)據(jù)量受GPU顯存限制;

3)對(duì)本身就需要GPU參與運(yùn)算的程序,如:3D游戲�,通用計(jì)算會(huì)爭(zhēng)奪GPU資源�,如果做平衡���?

4)計(jì)算數(shù)據(jù)之間的不相關(guān)性限制了GPU通用計(jì)算的應(yīng)用范圍�����;

5)CPU算法到適合GPU架構(gòu)算法的移植�;

最后���,GPU硬件設(shè)計(jì)本身就已經(jīng)決定了它的強(qiáng)項(xiàng)是密集數(shù)據(jù)處理(如:科學(xué)計(jì)算�、醫(yī)療圖像處理)���,在邏輯處理方面還是CPU的天下�����,所以它們是互補(bǔ)的�����,只會(huì)有整合而非替代的趨勢(shì)。

[1] http://www2.kimicat.com/gpu%E7%9A%84%E7%A1%AC%E9%AB%94%E6%9E%B6%E6%A7%8B

[2] http://www.chip.cn/index.php?option=com_content&view=article&id=2857:geforce-gtx-400-gpu&catid=7:test-technology&Itemid=15

[3] http://www.geeks3d.com/20100606/gpu-computing-nvidia-cuda-compute-capability-comparative-table

[4] http://www.expreview.com/13590-2.html

[5] http://en.wikipedia.org/wiki/CUDA