Linux 2.6內(nèi)核中提高網(wǎng)絡(luò)I/O性能的新方法-epoll I/O多路復(fù)用技術(shù)在比較多的TCP網(wǎng)絡(luò)服務(wù)器中有使用,即比較多的用到select函數(shù)。

1、為什么select落后

首先,在Linux內(nèi)核中,select所用到的FD_SET是有限的,即內(nèi)核中有個(gè)參數(shù)__FD_SETSIZE定義了每個(gè)FD_SET的句柄個(gè)數(shù),在我用的2.6.15-25-386內(nèi)核中,該值是1024,搜索內(nèi)核源代碼得到:

include/linux/posix_types.h:

#define __FD_SETSIZE 1024

也就是說(shuō),如果想要同時(shí)檢測(cè)1025個(gè)句柄的可讀狀態(tài)是不可能用select實(shí)現(xiàn)的。或者同時(shí)檢測(cè)1025個(gè)句柄的可寫(xiě)狀態(tài)也是不可能的。其次,內(nèi)核中實(shí)現(xiàn) select是用輪詢(xún)方法,即每次檢測(cè)都會(huì)遍歷所有FD_SET中的句柄,顯然,select函數(shù)執(zhí)行時(shí)間與FD_SET中的句柄個(gè)數(shù)有一個(gè)比例關(guān)系,即 select要檢測(cè)的句柄數(shù)越多就會(huì)越費(fèi)時(shí)。當(dāng)然,在前文中我并沒(méi)有提及poll方法,事實(shí)上用select的朋友一定也試過(guò)poll,我個(gè)人覺(jué)得 select和poll大同小異,個(gè)人偏好于用select而已。

2、內(nèi)核中提高I/O性能的新方法epoll

epoll是什么?按照man手冊(cè)的說(shuō)法:是為處理大批量句柄而作了改進(jìn)的poll。要使用epoll只需要這三個(gè)系統(tǒng)調(diào)用:epoll_create(2), epoll_ctl(2), epoll_wait(2)。

當(dāng)然,這不是2.6內(nèi)核才有的,它是在2.5.44內(nèi)核中被引進(jìn)的(epoll(4) is a new API introduced in Linux kernel 2.5.44)

Linux2.6內(nèi)核epoll介紹

先介紹2本書(shū)《The Linux Networking Architecture--Design and Implementation of Network Protocols in the Linux Kernel》,以2.4內(nèi)核講解Linux TCP/IP實(shí)現(xiàn),相當(dāng)不錯(cuò).作為一個(gè)現(xiàn)實(shí)世界中的實(shí)現(xiàn),很多時(shí)候你必須作很多權(quán)衡,這時(shí)候參考一個(gè)久經(jīng)考驗(yàn)的系統(tǒng)更有實(shí)際意義。舉個(gè)例子,linux內(nèi)核中sk_buff結(jié)構(gòu)為了追求速度和安全,犧牲了部分內(nèi)存,所以在發(fā)送TCP包的時(shí)候,無(wú)論應(yīng)用層數(shù)據(jù)多大,sk_buff最小也有272的字節(jié).其實(shí)對(duì)于socket應(yīng)用層程序來(lái)說(shuō),另外一本書(shū)《UNIX Network Programming Volume 1》意義更大一點(diǎn).2003年的時(shí)候,這本書(shū)出了最新的第3版本,不過(guò)主要還是修訂第2版本。其中第6章《I/O Multiplexing》是最重要的。Stevens給出了網(wǎng)絡(luò)IO的基本模型。在這里最重要的莫過(guò)于select模型和Asynchronous I/O模型.從理論上說(shuō),AIO似乎是最高效的,你的IO操作可以立即返回,然后等待os告訴你IO操作完成。但是一直以來(lái),如何實(shí)現(xiàn)就沒(méi)有一個(gè)完美的方案。最著名的windows完成端口實(shí)現(xiàn)的AIO,實(shí)際上也是內(nèi)部用線程池實(shí)現(xiàn)的罷了,最后的結(jié)果是IO有個(gè)線程池,你應(yīng)用也需要一個(gè)線程池...... 很多文檔其實(shí)已經(jīng)指出了這帶來(lái)的線程context-switch帶來(lái)的代價(jià)。在linux 平臺(tái)上,關(guān)于網(wǎng)絡(luò)AIO一直是改動(dòng)最多的地方,2.4的年代就有很多AIO內(nèi)核patch,最著名的應(yīng)該算是SGI那個(gè)。但是一直到2.6內(nèi)核發(fā)布,網(wǎng)絡(luò)模塊的AIO一直沒(méi)有進(jìn)入穩(wěn)定內(nèi)核版本(大部分都是使用用戶線程模擬方法,在使用了NPTL的linux上面其實(shí)和windows的完成端口基本上差不多了)。2.6內(nèi)核所支持的AIO特指磁盤(pán)的AIO---支持io_submit(),io_getevents()以及對(duì)Direct IO的支持(就是繞過(guò)VFS系統(tǒng)buffer直接寫(xiě)硬盤(pán),對(duì)于流服務(wù)器在內(nèi)存平穩(wěn)性上有相當(dāng)幫助)。

所以,剩下的select模型基本上就是我們?cè)趌inux上面的唯一選擇,其實(shí),如果加上no-block socket的配置,可以完成一個(gè)"偽"AIO的實(shí)現(xiàn),只不過(guò)推動(dòng)力在于你而不是os而已。不過(guò)傳統(tǒng)的select/poll函數(shù)有著一些無(wú)法忍受的缺點(diǎn),所以改進(jìn)一直是2.4-2.5開(kāi)發(fā)版本內(nèi)核的任務(wù),包括/dev/poll,realtime signal等等。最終,Davide Libenzi開(kāi)發(fā)的epoll進(jìn)入2.6內(nèi)核成為正式的解決方案

3、epoll的優(yōu)點(diǎn)

<1>支持一個(gè)進(jìn)程打開(kāi)大數(shù)目的socket描述符(FD)

select 最不能忍受的是一個(gè)進(jìn)程所打開(kāi)的FD是有一定限制的,由FD_SETSIZE設(shè)置,默認(rèn)值是2048。對(duì)于那些需要支持的上萬(wàn)連接數(shù)目的IM服務(wù)器來(lái)說(shuō)顯然太少了。這時(shí)候你一是可以選擇修改這個(gè)宏然后重新編譯內(nèi)核,不過(guò)資料也同時(shí)指出這樣會(huì)帶來(lái)網(wǎng)絡(luò)效率的下降,二是可以選擇多進(jìn)程的解決方案(傳統(tǒng)的 Apache方案),不過(guò)雖然linux上面創(chuàng)建進(jìn)程的代價(jià)比較小,但仍舊是不可忽視的,加上進(jìn)程間數(shù)據(jù)同步遠(yuǎn)比不上線程間同步的高效,所以也不是一種完美的方案。不過(guò) epoll則沒(méi)有這個(gè)限制,它所支持的FD上限是最大可以打開(kāi)文件的數(shù)目,這個(gè)數(shù)字一般遠(yuǎn)大于2048,舉個(gè)例子,在1GB內(nèi)存的機(jī)器上大約是10萬(wàn)左右,具體數(shù)目可以cat /proc/sys/fs/file-max察看,一般來(lái)說(shuō)這個(gè)數(shù)目和系統(tǒng)內(nèi)存關(guān)系很大。

<2>IO效率不隨FD數(shù)目增加而線性下降

傳統(tǒng)的select/poll另一個(gè)致命弱點(diǎn)就是當(dāng)你擁有一個(gè)很大的socket集合,不過(guò)由于網(wǎng)絡(luò)延時(shí),任一時(shí)間只有部分的socket是"活躍"的,但是select/poll每次調(diào)用都會(huì)線性掃描全部的集合,導(dǎo)致效率呈現(xiàn)線性下降。但是epoll不存在這個(gè)問(wèn)題,它只會(huì)對(duì)"活躍"的socket進(jìn)行操作---這是因?yàn)樵趦?nèi)核實(shí)現(xiàn)中epoll是根據(jù)每個(gè)fd上面的callback函數(shù)實(shí)現(xiàn)的。那么,只有"活躍"的socket才會(huì)主動(dòng)的去調(diào)用 callback函數(shù),其他idle狀態(tài)socket則不會(huì),在這點(diǎn)上,epoll實(shí)現(xiàn)了一個(gè)"偽"AIO,因?yàn)檫@時(shí)候推動(dòng)力在os內(nèi)核。在一些 benchmark中,如果所有的socket基本上都是活躍的---比如一個(gè)高速LAN環(huán)境,epoll并不比select/poll有什么效率,相反,如果過(guò)多使用epoll_ctl,效率相比還有稍微的下降。但是一旦使用idle connections模擬WAN環(huán)境,epoll的效率就遠(yuǎn)在select/poll之上了。

<3>使用mmap加速內(nèi)核與用戶空間的消息傳遞。

這點(diǎn)實(shí)際上涉及到epoll的具體實(shí)現(xiàn)了。無(wú)論是select,poll還是epoll都需要內(nèi)核把FD消息通知給用戶空間,如何避免不必要的內(nèi)存拷貝就很重要,在這點(diǎn)上,epoll是通過(guò)內(nèi)核于用戶空間mmap同一塊內(nèi)存實(shí)現(xiàn)的。而如果你想我一樣從2.5內(nèi)核就關(guān)注epoll的話,一定不會(huì)忘記手工 mmap這一步的。

<4>內(nèi)核微調(diào)

這一點(diǎn)其實(shí)不算epoll的優(yōu)點(diǎn)了,而是整個(gè)linux平臺(tái)的優(yōu)點(diǎn)。也許你可以懷疑 linux平臺(tái),但是你無(wú)法回避linux平臺(tái)賦予你微調(diào)內(nèi)核的能力。比如,內(nèi)核TCP/IP協(xié)議棧使用內(nèi)存池管理sk_buff結(jié)構(gòu),那么可以在運(yùn)行時(shí)期動(dòng)態(tài)調(diào)整這個(gè)內(nèi)存pool(skb_head_pool)的大小--- 通過(guò)echo XXXX>/proc/sys/net/core/hot_list_length完成。再比如listen函數(shù)的第2個(gè)參數(shù)(TCP完成3次握手的數(shù)據(jù)包隊(duì)列長(zhǎng)度),也可以根據(jù)你平臺(tái)內(nèi)存大小動(dòng)態(tài)調(diào)整。更甚至在一個(gè)數(shù)據(jù)包面數(shù)目巨大但同時(shí)每個(gè)數(shù)據(jù)包本身大小卻很小的特殊系統(tǒng)上嘗試最新的NAPI網(wǎng)卡驅(qū)動(dòng)架構(gòu)。

4、epoll的工作模式

令人高興的是,2.6內(nèi)核的epoll比其2.5開(kāi)發(fā)版本的/dev/epoll簡(jiǎn)潔了許多,所以,大部分情況下,強(qiáng)大的東西往往是簡(jiǎn)單的。唯一有點(diǎn)麻煩是epoll有2種工作方式:LT和ET。

LT(level triggered)是缺省的工作方式,并且同時(shí)支持block和no-block socket.在這種做法中,內(nèi)核告訴你一個(gè)文件描述符是否就緒了,然后你可以對(duì)這個(gè)就緒的fd進(jìn)行IO操作。如果你不作任何操作,內(nèi)核還是會(huì)繼續(xù)通知你的,所以,這種模式編程出錯(cuò)誤可能性要小一點(diǎn)。傳統(tǒng)的select/poll都是這種模型的代表.

ET (edge-triggered)是高速工作方式,只支持no-block socket。在這種模式下,當(dāng)描述符從未就緒變?yōu)榫途w時(shí),內(nèi)核通過(guò)epoll告訴你。然后它會(huì)假設(shè)你知道文件描述符已經(jīng)就緒,并且不會(huì)再為那個(gè)文件描述符發(fā)送更多的就緒通知,直到你做了某些操作導(dǎo)致那個(gè)文件描述符不再為就緒狀態(tài)了(比如,你在發(fā)送,接收或者接收請(qǐng)求,或者發(fā)送接收的數(shù)據(jù)少于一定量時(shí)導(dǎo)致了一個(gè)EWOULDBLOCK 錯(cuò)誤)。但是請(qǐng)注意,如果一直不對(duì)這個(gè)fd作IO操作(從而導(dǎo)致它再次變成未就緒),內(nèi)核不會(huì)發(fā)送更多的通知(only once),不過(guò)在TCP協(xié)議中,ET模式的加速效用仍需要更多的benchmark確認(rèn)。

epoll只有epoll_create,epoll_ctl,epoll_wait 3個(gè)系統(tǒng)調(diào)用,具體用法請(qǐng)參考http://www.xmailserver.org/linux-patches/nio-improve.html ,在http://www.kegel.com/rn/也有一個(gè)完整的例子,大家一看就知道如何使用了

Leader/follower模式線程pool實(shí)現(xiàn),以及和epoll的配合。

5、 epoll的使用方法

首先通過(guò)create_epoll(int maxfds)來(lái)創(chuàng)建一個(gè)epoll的句柄,其中maxfds為你epoll所支持的最大句柄數(shù)。這個(gè)函數(shù)會(huì)返回一個(gè)新的epoll句柄,之后的所有操作將通過(guò)這個(gè)句柄來(lái)進(jìn)行操作。在用完之后,記得用close()來(lái)關(guān)閉這個(gè)創(chuàng)建出來(lái)的epoll句柄。之后在你的網(wǎng)絡(luò)主循環(huán)里面,每一幀的調(diào)用epoll_wait(int epfd, epoll_event events, int max events, int timeout)來(lái)查詢(xún)所有的網(wǎng)絡(luò)接口,看哪一個(gè)可以讀,哪一個(gè)可以寫(xiě)了。基本的語(yǔ)法為:

nfds = epoll_wait(kdpfd, events, maxevents, -1);

其中kdpfd為用epoll_create創(chuàng)建之后的句柄,events是一個(gè)epoll_event*的指針,當(dāng)epoll_wait這個(gè)函數(shù)操作成功之后,epoll_events里面將儲(chǔ)存所有的讀寫(xiě)事件。max_events是當(dāng)前需要監(jiān)聽(tīng)的所有socket句柄數(shù)。最后一個(gè)timeout是 epoll_wait的超時(shí),為0的時(shí)候表示馬上返回,為-1的時(shí)候表示一直等下去,直到有事件范圍,為任意正整數(shù)的時(shí)候表示等這么長(zhǎng)的時(shí)間,如果一直沒(méi)有事件,則范圍。一般如果網(wǎng)絡(luò)主循環(huán)是單獨(dú)的線程的話,可以用-1來(lái)等,這樣可以保證一些效率,如果是和主邏輯在同一個(gè)線程的話,則可以用0來(lái)保證主循環(huán)的效率。

epoll_wait范圍之后應(yīng)該是一個(gè)循環(huán),遍利所有的事件:

for(n = 0; n < nfds; ++n) {

if(events[n].data.fd == listener) { //如果是主socket的事件的話,則表示有新連接進(jìn)入了,進(jìn)行新連接的處理。

client = accept(listener, (struct sockaddr *) &local, &addrlen);

if(client < 0){

perror("accept");

continue;

}

setnonblocking(client); // 將新連接置于非阻塞模式

ev.events = EPOLLIN | EPOLLET; // 并且將新連接也加入EPOLL的監(jiān)聽(tīng)隊(duì)列。

//注意,這里的參數(shù)EPOLLIN | EPOLLET并沒(méi)有設(shè)置對(duì)寫(xiě)socket的監(jiān)聽(tīng),

//如果有寫(xiě)操作的話,這個(gè)時(shí)候epoll是不會(huì)返回事件的,

//如果要對(duì)寫(xiě)操作也監(jiān)聽(tīng)的話,應(yīng)該是EPOLLIN | EPOLLOUT | EPOLLET

ev.data.fd = client;

if (epoll_ctl(kdpfd, EPOLL_CTL_ADD, client, &ev) < 0) { // 設(shè)置好event之后,將這個(gè)新的event通過(guò)epoll_ctl

//加入到epoll的監(jiān)聽(tīng)隊(duì)列里面,這里用EPOLL_CTL_ADD

//來(lái)加一個(gè)新的 epoll事件,通過(guò)EPOLL_CTL_DEL來(lái)減少

//一個(gè)epoll事件,通過(guò)EPOLL_CTL_MOD來(lái)改變一個(gè)事件的

//監(jiān)聽(tīng)方式。

fprintf(stderr, "epoll set insertion error: fd=%d0, client);

return -1;

}

} else // 如果不是主socket的事件的話,則代表是一個(gè)用戶socket的事件,

//則來(lái)處理這個(gè)用戶socket的事情,比如說(shuō)read(fd,xxx)之類(lèi)的,或者一些其他的處理。

do_use_fd(events[n].data.fd);

}

對(duì),epoll的操作就這么簡(jiǎn)單,總共不過(guò)4個(gè)API:epoll_create, epoll_ctl, epoll_wait和close。

如果您對(duì)epoll的效率還不太了解,請(qǐng)參考我之前關(guān)于網(wǎng)絡(luò)游戲的網(wǎng)絡(luò)編程等相關(guān)的文章。

以前公司的服務(wù)器都是使用HTTP連接,但是這樣的話,在手機(jī)目前的網(wǎng)絡(luò)情況下不但顯得速度較慢,而且不穩(wěn)定。因此大家一致同意用 SOCKET來(lái)進(jìn)行連接。雖然使用SOCKET之后,對(duì)于用戶的費(fèi)用可能會(huì)增加(由于是用了CMNET而非CMWAP),但是,秉著用戶體驗(yàn)至上的原則,相信大家還是能夠接受的(希望那些玩家月末收到帳單不后能夠保持克制...)。

這次的服務(wù)器設(shè)計(jì)中,最重要的一個(gè)突破,是使用了EPOLL模型,雖然對(duì)之也是一知半解,但是既然在各大PC網(wǎng)游中已經(jīng)經(jīng)過(guò)了如此嚴(yán)酷的考驗(yàn),相信他不會(huì)讓我們失望,使用后的結(jié)果,確實(shí)也是表現(xiàn)相當(dāng)不錯(cuò)。在這里,我還是主要大致介紹一下這個(gè)模型的結(jié)構(gòu)。

6、Linux下EPOll編程實(shí)例

EPOLL模型似乎只有一種格式,所以大家只要參考我下面的代碼,就能夠?qū)POLL有所了解了,代碼的解釋都已經(jīng)在注釋中:

while (TRUE) {

int nfds = epoll_wait (m_epoll_fd, m_events, MAX_EVENTS, EPOLL_TIME_OUT);//等待EPOLL時(shí)間的發(fā)生,相當(dāng)于監(jiān)聽(tīng),

//至于相關(guān)的端口,需要在初始化EPOLL的時(shí)候綁定。

if (nfds <= 0)

continue;

m_bOnTimeChecking = FALSE;

G_CurTime = time(NULL);

for (int i=0; i<nfds; i++) {

try {

if (m_events[i].data.fd == m_listen_http_fd)//如果新監(jiān)測(cè)到一個(gè)HTTP用戶連接到綁定的HTTP端口,

//建立新的連接。由于我們新采用了SOCKET連接,所以基本沒(méi)用。

{

OnAcceptHttpEpoll ();

} else if (m_events[i].data.fd == m_listen_sock_fd)//如果新監(jiān)測(cè)到一個(gè)SOCKET用戶連接到了綁定的SOCKET端口,

//建立新的連接。

{

OnAcceptSockEpoll ();

} else if (m_events[i].events & EPOLLIN)//如果是已經(jīng)連接的用戶,并且收到數(shù)據(jù),那么進(jìn)行讀入。

{

OnReadEpoll (i);

}

OnWriteEpoll (i);//查看當(dāng)前的活動(dòng)連接是否有需要寫(xiě)出的數(shù)據(jù)。

} catch (int) {

PRINTF ("CATCH捕獲錯(cuò)誤\n");

continue;

}

}

m_bOnTimeChecking = TRUE;

OnTimer ();//進(jìn)行一些定時(shí)的操作,主要就是刪除一些短線用戶等。

}

其實(shí)EPOLL的精華,也就是上述的幾段短短的代碼,看來(lái)時(shí)代真的不同了,以前如何接受大量用戶連接的問(wèn)題,現(xiàn)在卻被如此輕松的搞定,真是讓人不得不感嘆,對(duì)哪。

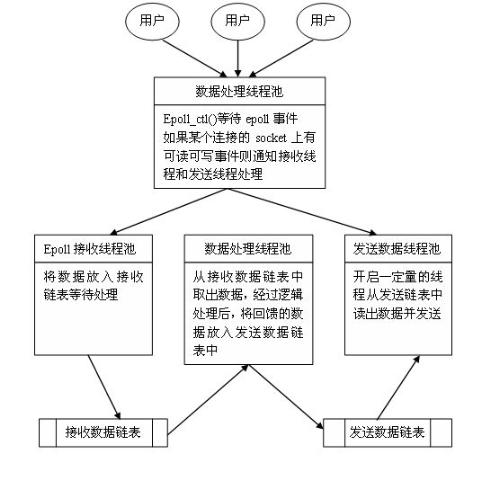

Epoll模型主要負(fù)責(zé)對(duì)大量并發(fā)用戶的請(qǐng)求進(jìn)行及時(shí)處理,完成服務(wù)器與客戶端的數(shù)據(jù)交互。其具體的實(shí)現(xiàn)步驟如下:

(a) 使用epoll_create()函數(shù)創(chuàng)建文件描述,設(shè)定將可管理的最大socket描述符數(shù)目。

(b) 創(chuàng)建與epoll關(guān)聯(lián)的接收線程,應(yīng)用程序可以創(chuàng)建多個(gè)接收線程來(lái)處理epoll上的讀通知事件,線程的數(shù)量依賴(lài)于程序的具體需要。

(c) 創(chuàng)建一個(gè)偵聽(tīng)socket描述符ListenSock;將該描述符設(shè)定為非阻塞模式,調(diào)用Listen()函數(shù)在套接字上偵聽(tīng)有無(wú)新的連接請(qǐng)求,在epoll_event結(jié)構(gòu)中設(shè)置要處理的事件類(lèi)型EPOLLIN,工作方式為 epoll_ET,以提高工作效率,同時(shí)使用epoll_ctl()注冊(cè)事件,最后啟動(dòng)網(wǎng)絡(luò)監(jiān)視線程。

(d) 網(wǎng)絡(luò)監(jiān)視線程啟動(dòng)循環(huán),epoll_wait()等待epoll事件發(fā)生。

(e) 如果epoll事件表明有新的連接請(qǐng)求,則調(diào)用accept()函數(shù),將用戶socket描述符添加到epoll_data聯(lián)合體,同時(shí)設(shè)定該描述符為非阻塞,并在epoll_event結(jié)構(gòu)中設(shè)置要處理的事件類(lèi)型為讀和寫(xiě),工作方式為epoll_ET.

(f) 如果epoll事件表明socket描述符上有數(shù)據(jù)可讀,則將該socket描述符加入可讀隊(duì)列,通知接收線程讀入數(shù)據(jù),并將接收到的數(shù)據(jù)放入到接收數(shù)據(jù)的鏈表中,經(jīng)邏輯處理后,將反饋的數(shù)據(jù)包放入到發(fā)送數(shù)據(jù)鏈表中,等待由發(fā)送線程發(fā)送。